JSAIレポート(1)の続きです。

グラフ

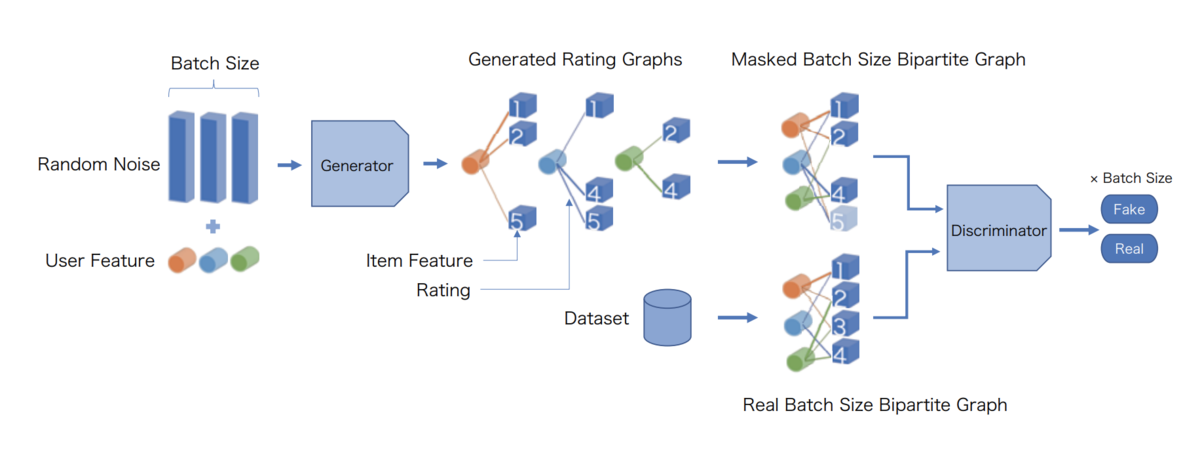

グラフ畳み込み層を有する敵対的生成ネットワークによる推薦システムの提案

https://confit.atlas.jp/guide/event-img/jsai2019/1J2-J-6-01/public/pdf?type=in

ユーザーの特徴ベクトルとアイテムの特徴ベクトルから尤もらしい嗜好グラフを生成するGeneratorと、与えられたグラフが本物かどうかを判定するグラフ畳み込み層持ちのDiscriminatorを敵対的に学習させる(GCGAN)ことでユーザー・アイテム間の関係を学習するというもの。正直2部グラフって実質ただのベクトルの集まりだし、グラフ使わなくてもいけるのでは...とか思ったりするのですが、これでうまく行ってしまうからGNNは困ったもんですね。(褒めてる)

関連: Graph Convolutional Matrix Completion, CF-GAN, GraphGAN

グラフ上の問題に対する難しいインスタンスの自動生成

我らが(研究室の)偉大な先輩である@joisinoさんの発表。TSPなどのグラフ上の問題に対する既存のアルゴリズムが苦戦する(解くのに時間がかかる)ようなグラフインスタンスを強化学習で生成してしまおうというもの。問題設定は即時強化学習(状態が一定)で、グラフを確率的な接続行列で表現してそれを行動とし、既存アルゴリズムが解くのに要した時間を報酬として強化学習を走らせる。

https://confit.atlas.jp/guide/event-img/jsai2019/1Q3-J-2-04/public/pdf?type=in

こんなところにも強化学習が適応できるのかと目から鱗な発表でした。

その他

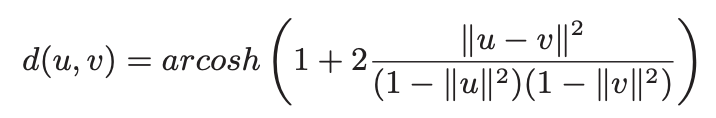

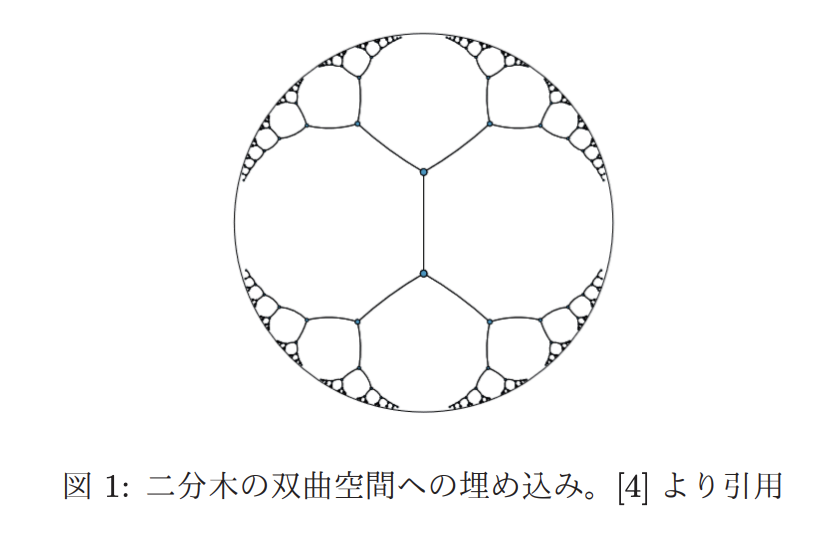

双曲空間上での単語および文章の意味の構造の埋め込みとその可視的な分析

https://confit.atlas.jp/guide/event-img/jsai2019/1J2-J-6-02/public/pdf?type=in

ポアンカレ円盤モデルという上の距離を入れた空間では、木構造のような親子構造をもつデータを可視的にうまく埋め込むことができることが知られている(Poincare Embedding)。これをarxiv上の論文をword2vec/doc2vecで変換してやってみたという発表。

即実用可能!というレベルの精度は出てないみたいですがこういう埋め込みがあるのは知らなかったので興味深いです。

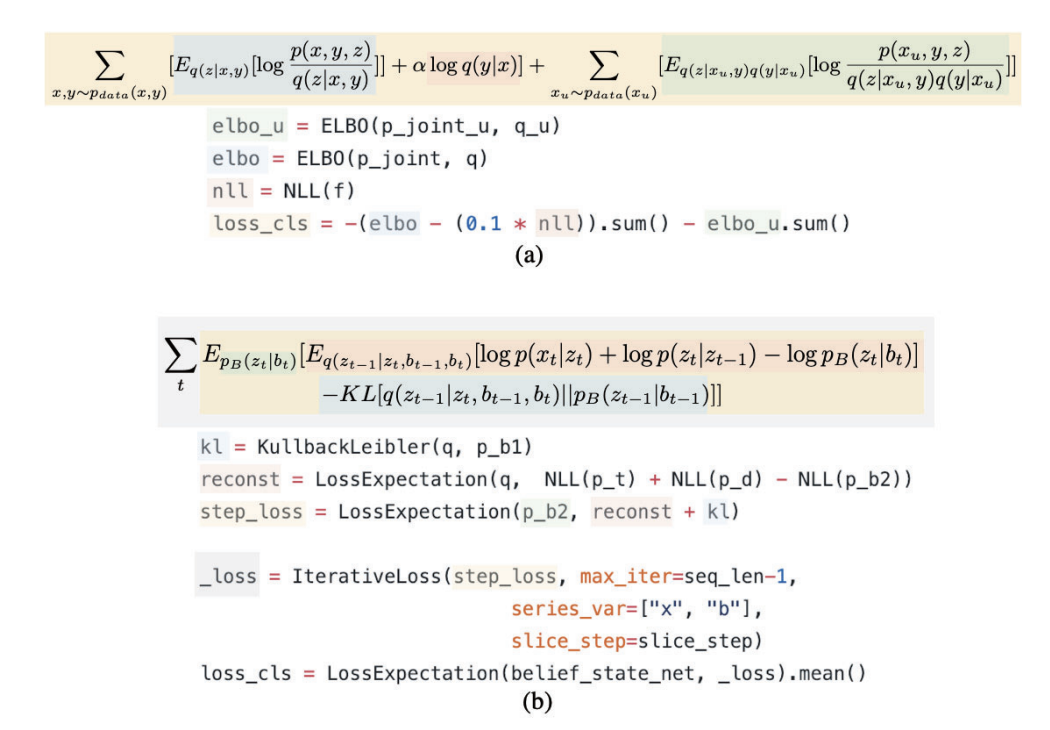

Pixyz: 複雑な深層生成モデル開発のためのフレームワーク

https://confit.atlas.jp/guide/event-img/jsai2019/1L2-J-11-05/public/pdf?type=in

複雑な深層生成確率モデルをコーディングするためのPythonフレームワークPixyzを作っているのでその紹介という珍しいタイプの発表。内部の複雑なニューラルネットのアーキテクチャを隠蔽し、外からは単純な確率モデルとして扱うことができ、その誤差やKLダイバージェンスを数式をそのまま書くように直感的かつ簡単にかけるというのが特徴。

機能や速度面はまだ改良途中のようですが誤差やサンプリングが簡単にかけるというのはかなり大きなメリットだと思うので複雑なモデルを書くときは検討してみたいです。

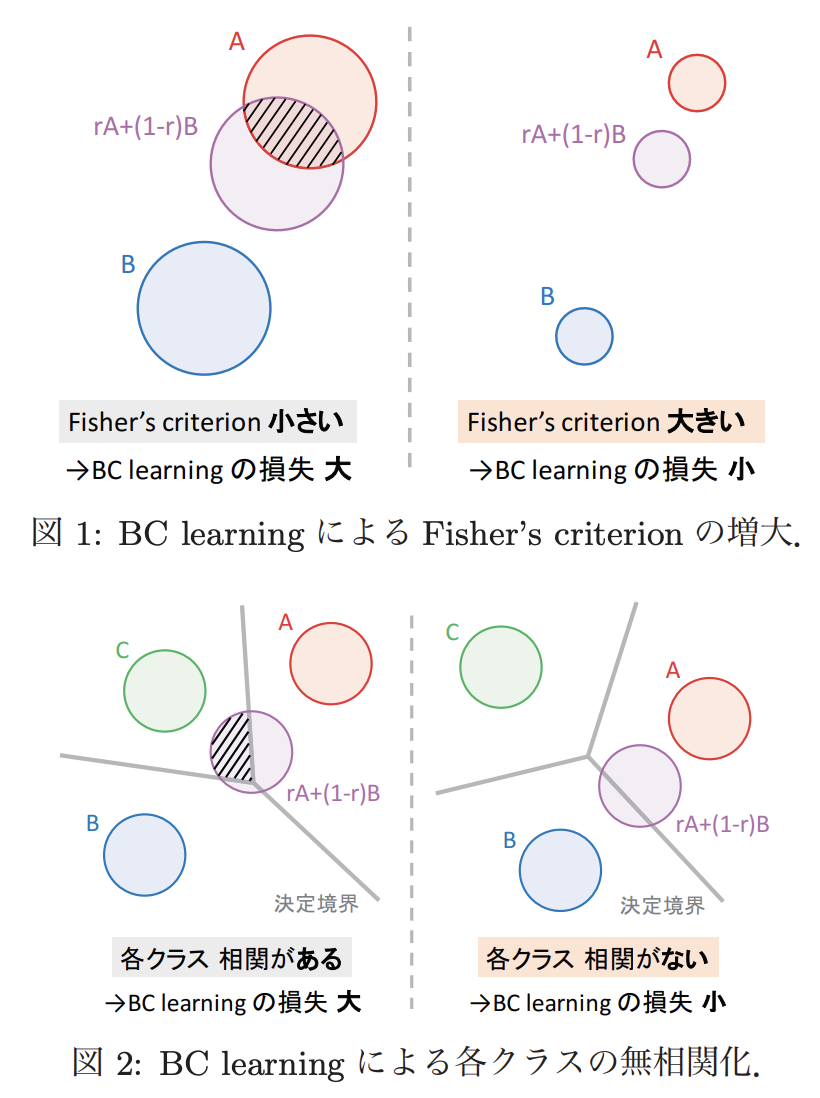

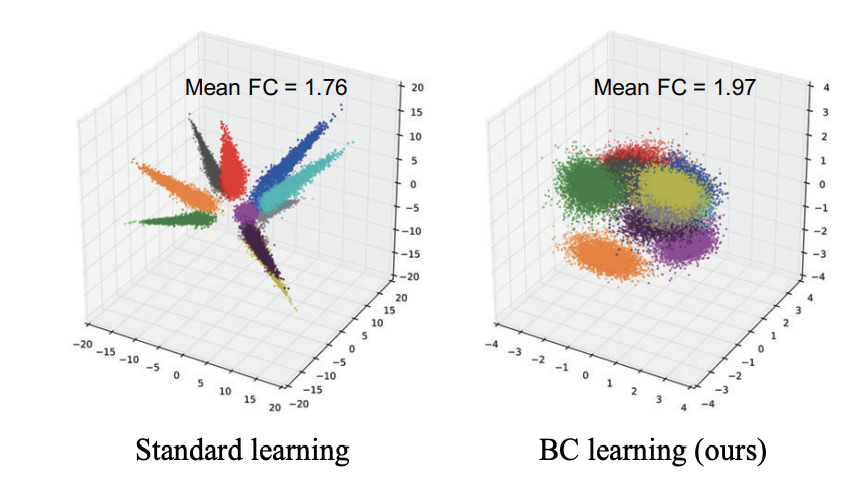

Between-class Learning for Image Classification

https://confit.atlas.jp/guide/event-img/jsai2019/3E4-OS-12b-02/public/pdf?type=in

異なるカテゴリに属する二つのサンプルを一定の比率で合成し、その合成比率を出力させるようなモデルを学習させることで判別的な(クラスの分離度が高い)特徴空間が学習されるというもの。

考え方は至ってシンプルながら斬新な手法で非常に興味深いです。不変学習との関連もあるか?

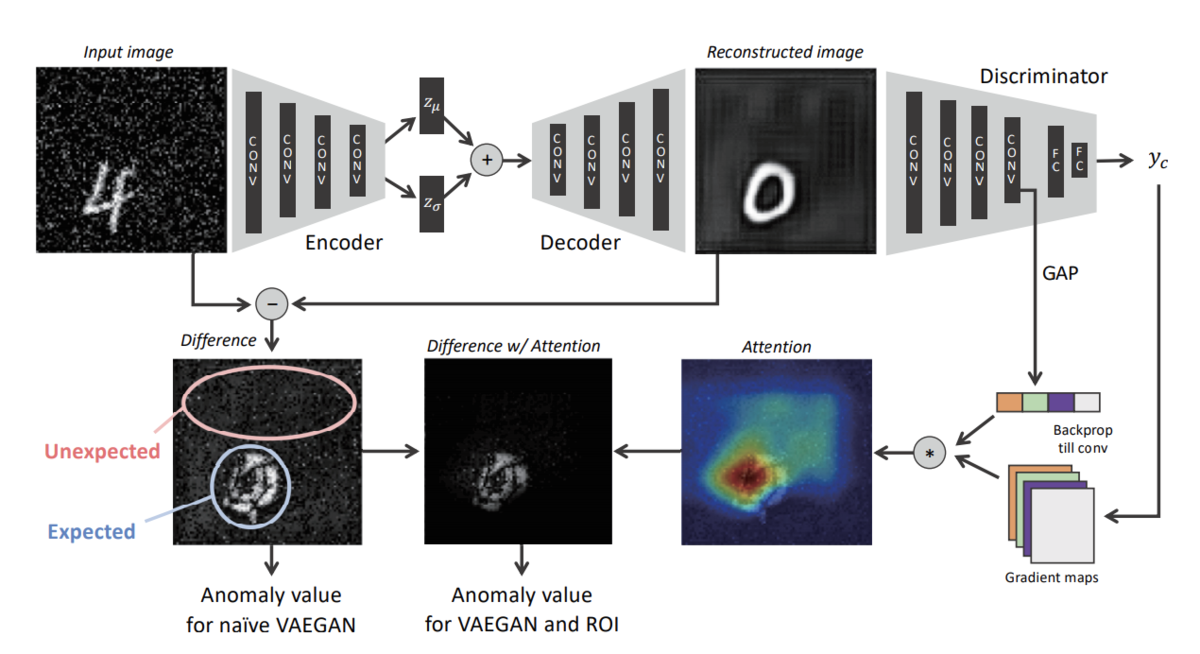

VAE-GANとAttentionを活用した異常検出手法

https://confit.atlas.jp/guide/event-img/jsai2019/4P3-J-10-02/public/pdf?type=in

VAEで画像を再構成した際の復元誤差によって異常度を測る手法は前からあったが、元々の画像に含まれるノイズも異常として検出されてしまうというノイズへの脆弱性があった。そこでGrad-CAMに基づいてAttentionを算出し、それを元の復元誤差にかけ合わせることで、Attentionの低い部分のノイズに対する頑健性を向上させることができるというもの。

画像の"写真らしさ"に関する数学的アプローチについて

https://confit.atlas.jp/guide/event-img/jsai2019/3K3-J-2-05/public/pdf?type=in

今回の学会の中でも異色な発表で、数学科の方が機械学習を全く使わず完全に数学的な特徴によって「写真」とそれ以外を識別することはできないかという試みの発表。画像の色の偏りに注目し、画像を複数のブロックに区切って画素値を0/1に変換した際に初めてそれらが全て同じ値になるようなブロックの大きさの最小値により画像の「深さ」を定義し、それが一定以下のものを準写真と定義している。

そもそもの「人間は生まれながら(学習なしに)写真とそれ以外を区別する能力を持っている」という仮定や閾値が本当に妥当かということについては議論の余地がありそうですが、この手法が最近よく聞くパーシステントホモロジーの文脈から着想を得ていることや試み自体のアイデアについては非常に面白く、参考になりました。

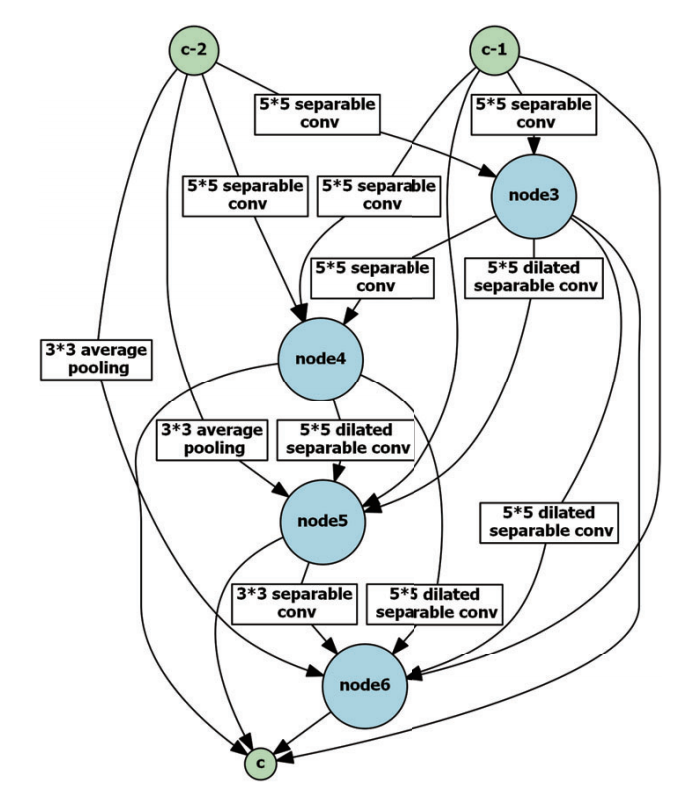

貢献度分配を導入した方策勾配によるNeural Architecture Searchの高速化

https://confit.atlas.jp/guide/event-img/jsai2019/2P3-J-2-02/public/pdf?type=in

ニューラルネットのアーキテクチャを自動で最適化するNeural Architecture Searchという分野があり、その中でもパラメータの最適化とアーキテクチャの最適化を同時に行うone-shotな手法が近年注目されている。各レイヤーをノードとみなしてそれらの間のオペレーション(畳み込み・プーリング・全結合など、恒等写像・ゼロ写像を含む)を適切に選択することで幅広いアーキテクチャの中から最適なものを見つけ出す。各オペレーションに対する最適なパラメータを保持しておくことでアーキテクチャとパラメータを同時に最適化できる。

従来の手法では全体の識別精度を元にモデルにという評価値を与え、この勾配に基づいてパラメータやアーキテクチャを更新していたが、

に対する貢献度はそれぞれのオペレーションによって異なるので、この貢献度をそれぞれのオペレーションの選択

についての

の偏微分値を用いて評価するようにしたことで、安定性・性能が向上した。

全体的な感想

最近注目を集めているグラフニューラルネット系の話題が少なかったのが意外でした。その一方で強化学習の話題が理論・応用ともに非常に多く、強化学習系に興味がある身としては参考になったと同時にホットな分野なんだと感じて嬉しかったです。

まだがっつり研究を始めている訳ではないので提案手法が直接ヒントになったとかはあまりなかったですが、不変学習をはじめとして新しい分野を知ることができたり、最新の研究の周辺知識(GAIL、エントロピー最大化逆強化学習、メタ学習等)としてどういうものがあってこれから勉強していかなければならないかが掴めたという点でとても有意義な機会でした。

おまけ

以上です。最後までお読み頂きありがとうございました!